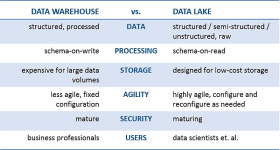

Darüber kann man streiten. Ziel ist es schon übergeordnete Analysen zu erstellen und irgendwann auch zu veröffentlichen bzw. die Daten zur Verfügung zu stellen. Das könnte wahrscheinlich auch über ein anderes System passieren, dass auf den Data Lake zugreift. So ganz klar ist mir der Unterschied auch nicht. Passt das Bild?

So im groben ja. Der wesentliche Punkt ist das Processing, denn bei on write ist die Struktur bekannt und die Quelle wird entsprechend zurecht gebaut mittels ETL Prozessen. Bei on read bist du halt flexibel, was ich so aus deinem letzten Absatz herausgelesen hatte mit "dass die Owner der Quellen eigenständig entscheiden können was sie ins Warehouse schicken und damit auch im Warehouse ihre Tabellen definieren" - kann ich aber auch falsch verstanden haben, wie deine kommenden Absätze zeigen.

Mein letzter Absatz soll Bedenken abfangen, dass es z.B. Daten aus Abteilung X gibt, die von Abteilung Y genutzt werden dürfen aber nicht von Abteilung Z for whatever reason. Darf ich kein Rechtemangement im Warehouse haben?

Es gibt bestimmt Bedenkenträger, wenn erstmal alle user des warehouses auf alles Zugriff haben.

Doch klar. Wir haben eine selbstentwickelte Rechteverwaltung ab der multidimensionalen Ebene die AD gestützt entsprechende Filterungen zulässt. Relational haben ohnehin nur Entwickler und der Betrieb Zugriff, damit muss man sich über eine Rechtekonstrukt auf der Ebene keine Gedanken machen und kann das entsprechend der Umgebung (Produktion / Entwicklung) justieren.

Worum es mir dabei ging ist, dass es keine Abteilung geben darf, die sich der Herausgabe verwehrt und stattdessen ein eigenständiges reporting betreibt. Ich komme bekanntermaßen aus der Logistik und wir haben relativ "häufig" mit dem Zoll oder Europol zu tun. Es gibt eine eigene Abteilung, die sich nur um Anfragen staatlicher Vollzugsbehörden kümmert und die sensiblen Daten haben wir selbstverständlich vorliegen. Vor allem reichern wir die Daten noch um deutlich mehr Informationen an, als die ursprünglichen operativen Systeme es je könnten. Damit haben wir jegliche Diskussion von Anfang erstickt, weil der Mehrwert zur Bearbeitung derartiger Anfragen dem ganzen Konzern hilft.

Was man immer vermeiden will, ist eine Art Schattensystem und zwei Quellen die eine Richtigkeit für sich beanspruchen, vor allem wenn das Ergebnis divergiert.

Stammdatenverwaltung ist bei uns ein mega cluster fuck und wird auch dadurch erschwert, dass an drölf Stellen neue Stammdaten erhoben werden.

Ist hier nicht anders und das ist eines der lessons learned oben - Data Governance frühzeitig betreiben. Bei uns ist das Kind schon in den Brunnen gefallen und seit mittlerweile 4 Jahren versuchen wir im Konzern das zu ändern. Ist mühselig, wenn sowas mehrere Jahrzehnte gewachsen ist, aber es wird.

Laufen bei Euch personenbezogene Daten ins Data Warehouse?

Ja, mit ganz wenigen Ausnahmen. Allerdings geht nicht alles raus an die Endanwender.

Mich interessiert mehr der Prozess, wenn eine Quelle ihr Schema ändert oder sie dazukommt. Wird der Prozess dann von der IT bzw. dem Team des Warehouses angepasst oder vom Team der Datenquelle. Und wie sieht der Prozess aus?

In der Kurzfassung läuft es meistens so, dass der Fachbereich ein Projekt hat und dafür einen PM stellt. Dieser meldet sich bei unseren PMs mit der Anforderung und bekommt entsprechend Aufwände mitgeteilt. Wenn dafür eine Anpassung in einem der Quellsysteme nötig ist, dann wird ein PM der entsprechenden Abteilung benannt und die Umstellung erfolgt dann in Absprache zwischen Quelle/Ziel.

Die Koordination geschieht natürlich übergeordnet und wird mehr oder minder vom steering vorgegeben.

Bei uns ändert keine Quelle einfach so ihr Schema und wenn doch, dann passiert sowas idR. einmal und nie wieder. Die Person wird zwar nicht entlassen, aber es wird deutlich gemacht, dass man in einem Konzern nicht einfach wyld an Datenquellen rumpfuschen kann.

Systeme beliefern sich oftmals gegenseitig mit Informationen und sowas betrifft dann idR. nicht nur uns alleine, sondern auch andere Systeme. Bei uns wäre das mit einem Ausfall von 1-2 Tagen auch nicht so schlimm, BI Systeme sind nicht kritisch. Wenn man aber damit ein operatives System lahmlegt, kann man schnell einen beachtlichen Schaden verursachen.

oder sonst noch jemand.

oder sonst noch jemand.